Quand Facebook recommande des articles mensongers à ses utilisateurs

Une installation Facebook à Berlin (2016) - TOBIAS SCHWARZ / AFP

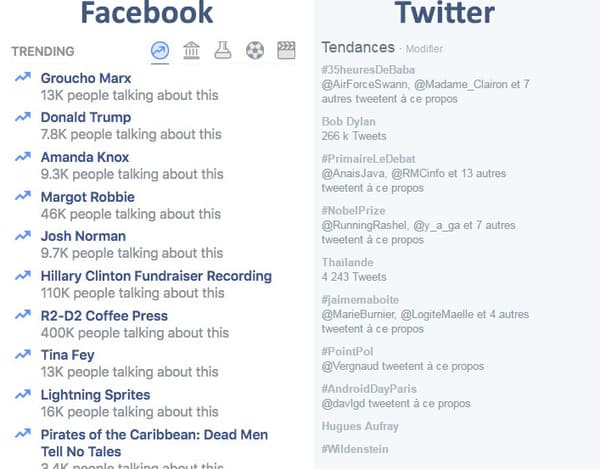

Depuis trois ans, les utilisateurs américains de Facebook profitent d’une liste des sujets les plus discutés sur le réseau social, baptisée Trending Topics. Un fonctionnement similaire à celui de Twitter, qui regroupe les principaux mots-clés sous le terme de Tendances. Depuis 2014, une équipe d’éditorialistes était chargée de réaliser la sélection, qui s’adaptait ensuite aux intérêts de chaque membre du réseau social. En août dernier, Facebook a décidé de s’en séparer pour la remplacer par des algorithmes. Depuis, le Washington Post a étudié les articles mis en avant. Parmi eux, des contenus discutables ont fait leur apparition.

Satires et théories du complot

Entre le 31 août et le 22 septembre, le média américain a débusqué cinq articles dont le contenu était inventé de toutes pièces et trois rapportant des informations “profondément inexactes”. Le Washington Post précise que son étude des Trending Topics s’est limitée aux heures de bureau. Il est donc possible que d’autres articles du même type aient été proposés aux membres de Facebook.

Le 29 août, un article mentionne une rixe opposant un employé de l’université de Clemson (Caroline du Sud) qui aurait reproché à un étudiant de prier sur le campus. Une information par la suite démentie. Le 8 septembre, un article du site parodique Faking News (Fausses Informations, en français) évoquait l’arrivée d’une nouvelle version de Siri, l’assistant virtuel proposé sur les smartphones et ordinateurs d’Apple. Ironique, le papier affirme que Siri serait prochainement capable de “sortir du téléphone et de se charger des tâches ménagères”. Le lendemain, un article contenant des thèses complotistes à propos des attentats du 11 septembre trouvait sa place dans la liste de sujets sélectionnés.

Qu’il s’agisse d’intox ou de traits d’humour, Facebook échoue régulièrement à discerner le vrai du faux. Et les exemples se multiplient depuis le remplacement des éditorialistes par des ingénieurs. Une situation “totalement prévisible pour ceux qui ont passé du temps sur cette fonctionnalité” explique un ancien de l’équipe au Washington Post. Cette automatisation avait été décidée à la suite du témoignage d’un autre ancien du réseau social. En mai dernier, il déclarait que les employés de Facebook avaient volontairement supprimé des contenus provenant du camp conservateur dans le cadre de la campagne présidentielle américaine.

L’objectivité plutôt que la vérification

C’est donc en voulant rendre ses recommandations plus neutres et objectives que Facebook est passé de la sélection par l’humain à celui de la machine. Malgré les critiques, il ne devrait pas y avoir de retour en arrière. Comme le déclarait un cadre fin août, le but est de rendre l’algorithme de plus en plus performant. Actuellement, il se base essentiellement sur le nombre d’articles traitant d’un même sujet et le nombre de partages. Jusqu’à cet été, son équipe validait chaque contenu après avoir vérifié la véracité des sources. Un travail journalistique, bien que Mark Zuckerberg se refuse à considérer Facebook comme un média.

Pourtant, le réseau social est l’un des acteurs médiatiques les plus importants. L’an dernier, il lançait Instant Articles, un service permettant de rendre les contenus d’actualité accessibles plus rapidement. De nombreux partenariats avec des éditeurs anglophones puis francophones ont depuis été noués. Pour les Américains comme pour les Français, Facebook est l’une des principales sources d’information. Selon l’édition 2015 du baromètre du numérique publié par l'Arcep, 71% des Français utilisent les réseaux sociaux pour s’informer. Un chiffre qui monte à 77% chez les 12-17 ans.

Régulièrement, Facebook est accusé de biaiser l’accès à l’information en ne proposant à ses utilisateurs que des contenus qui sont supposés les intéresser. Malgré son ambition de neutralité, la fonction Trending Topics pourrait amplifier le phénomène en arrivant en France et ailleurs dans le monde. Pour cela, Facebook devra réaliser ce tri d’information à grande échelle et dans toutes les langues. Par exemple, en utilisant toujours plus d’algorithmes.